5.3 完全分布式运行模式

前面学习的本地运行模式和伪分布运行模式, 本质上来说都是一种单节点运行模式.

他们在实际生产环境中没有用处.

但是在开发调试阶段这种单节点运行模式则特别的有用.

在后面开发MapReduce程序时再来体会.

在实际生产环境中, 节点的数量可以很多, 这种运行模式才是完全分布式运行模式.

我们以3个节点为例, 来搭建完全分布模式的运行环境.

5.3.1 虚拟机准备

准备 3 个虚拟机. 假设他们的地址分别是:

192.168.1.201

192.168.1.202

192.168.1.203

并在/etc/hosts文件中做域名映射:

192.168.1.201 hadoop201

192.168.1.202 hadoop202

192.168.1.203 hadoop203

5.3.2 编写集群分发脚本

在集群中, 一般情况下每个节点的配置都是一样的, 所以一般会在一个节点配置完成后, 然后再分发到其他节点上.

所以, 我们可以自己写一个这样的集群分发脚本来完成这个工作.

假设我们的配置是先在hadoop201上配置完成, 然后再分发到其他节点上: hadoop202, hadoop203

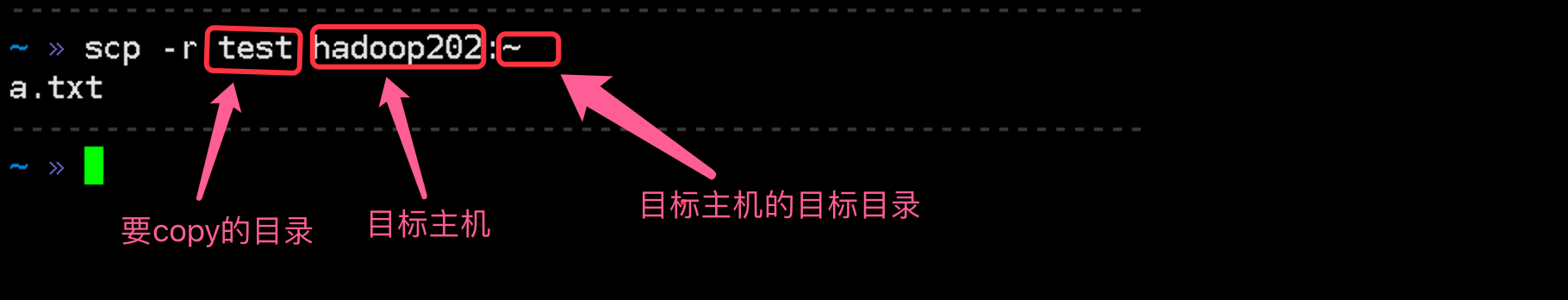

scp(安全拷贝 secure copy)

和以前学习的cp命令差不多, 只是cp是同一台主机内部文件或目录的copy

而scp可以跨主机进行copy

rsync

rsync:远程同步工具,主要用于备份和镜像。

具有速度快、避免复制相同内容和支持符号链接的优点。

rsync和scp区别:用rsync做文件的复制要比scp的速度快,rsync只对差异文件做更新。scp是把所有文件都复制过去。

rsync -rvl test hadoop202:~

选项:

r: 递归

v: 显示复制过程

l: copy符号链接(软链接)

集群分发脚本

循环复制指定目录下的所有目录和文件到其他主机的相同位置.

目标主机和当前主机有相同的目录借结构.

原始copy

假设原始功能: 向两台主机进行分发内容

rsync /opt/module hadoop202:/opt/

rsync /opt/module hadoop203:/opt/

自定义脚本

执行下面的脚本: my_rsync, 可以达到与上面同样的功能.

并且脚本可以在任意的地方直接执行.

my_rsync /opt/module

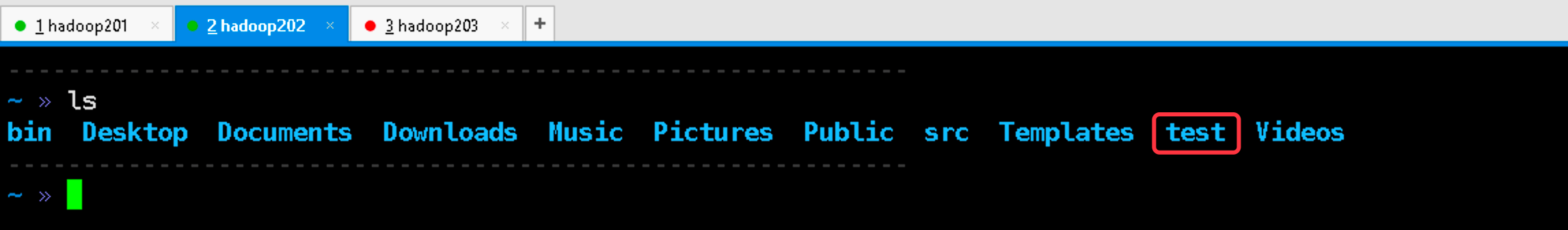

在当前用户的家目录下下创建一个目录

bin测试

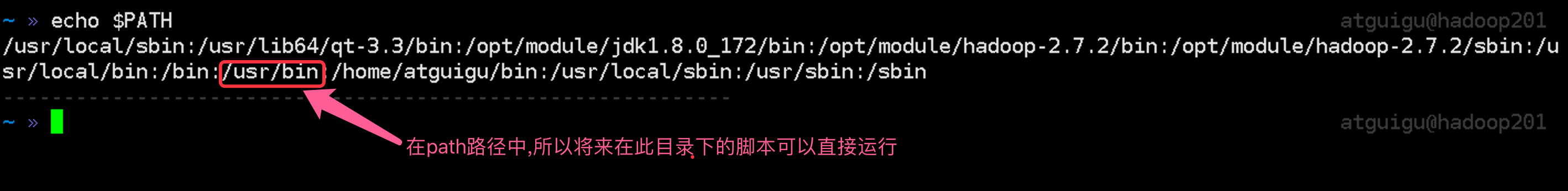

~/bin有没有在path路径中, 如果没有则添加到path路径中.

在

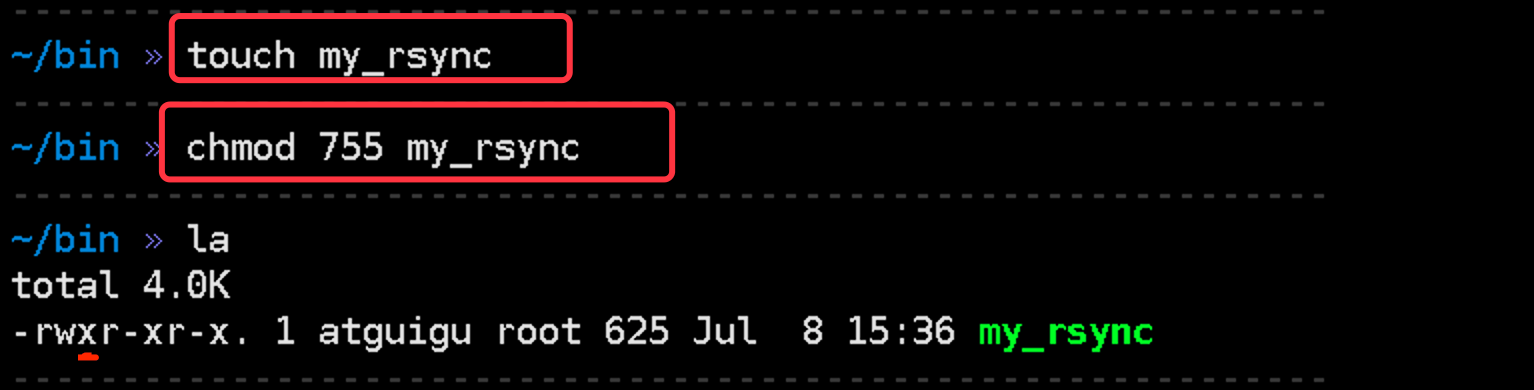

~/bin目录下创建文件my_rsync, 并给改文件添加可执行权限

编辑

~/bin/my_rsync脚本#!/bin/bash #1. 获取参数个数 argscount=$# if [ $argscount == 0 ] then echo 没有参数,输入你想要copy的目录或文件, 然后重试 exit fi #2. 获取目录或者文件名称 p1=$1 fileName=$(basename $p1) echo fileName=$fileName #3. 获取上级目录的绝对路径 fileDir=$(cd -P $(dirname $p1);pwd) echo fileDir=$fileDir #4. 获取当前用户名 user=$(whoami) echo user=$user #5. 循环同步copy文件 for((host=202;host<204;host++)) do echo --------开始向主机:hadoop$host copy 文件-------- rsync -rvl $p1 $user@hadoop$host:$fileDir echo --------结束向主机:hadoop$host copy 文件-------- done

5.3.3 集群配置

集群规划部署

现在我们有 3 个服务器节点, 可以根据实际情况来合理每个服务器节点的功能.

安装如下意图来配置集群:

| hadoop101 | hadoop102 | hadoop103 | |

|---|---|---|---|

| HDFS | NameNode DataNode | DataNode | SecondaryNameNode DataNode |

| YARN | NodeManager | ResourceManager NodeManager | NodeManager |

配置集群

配置

etc/hadoop/core-site.xml<!-- 指定HDFS中NameNode的地址 --> <property> <name>fs.defaultFS</name> <!-- 地址要根据自己实际情况来写. 具体的ip地址也是可以的 --> <value>hdfs://hadoop201:9000</value> </property> <!-- 指定hadoop运行时产生文件的存储目录 --> <property> <name>hadoop.tmp.dir</name> <value>/opt/module/hadoop-2.7.2/data/tmp</value> </property>配置

hdfs-site.xml<property> <name>dfs.replication</name> <!--副本的个数设置 3 --> <value>3</value> </property> <!--设置SecondaryNameNode的地址--> <property> <name>dfs.namenode.secondary.http-address</name> <value>hadoop203:50090</value> </property>配置

yarn-site.xml<!-- reducer获取数据的方式 --> <property> <name>yarn.nodemanager.aux-services</name> <value>mapreduce_shuffle</value> </property> <!-- 指定YARN的ResourceManager的地址 --> <property> <name>yarn.resourcemanager.hostname</name> <value>hadoop102</value> </property>配置

mapred-site.xml如果没有这个文件就先复制:

mapred-site.xml.template<!-- 指定MapReduce程序运行在yarn上 --> <property> <name>mapreduce.framework.name</name> <value>yarn</value> </property>分别给 3 个

env文件:hadoop-env.sh, yarn-env.sh, mapred-env.sh配置JAVA_HOME环境变量export JAVA_HOME=/opt/module/jdk1.8.0_172把配置好的文件分发到集群其他节点(

hadoop202, hadoop203)上my_rsync hadoop-2.7.2注意:

copy的过程中需要输入密码.

去其他节点查看文件分发情况.

集群单点启动

如果是集群第一次启动, 需要格式化

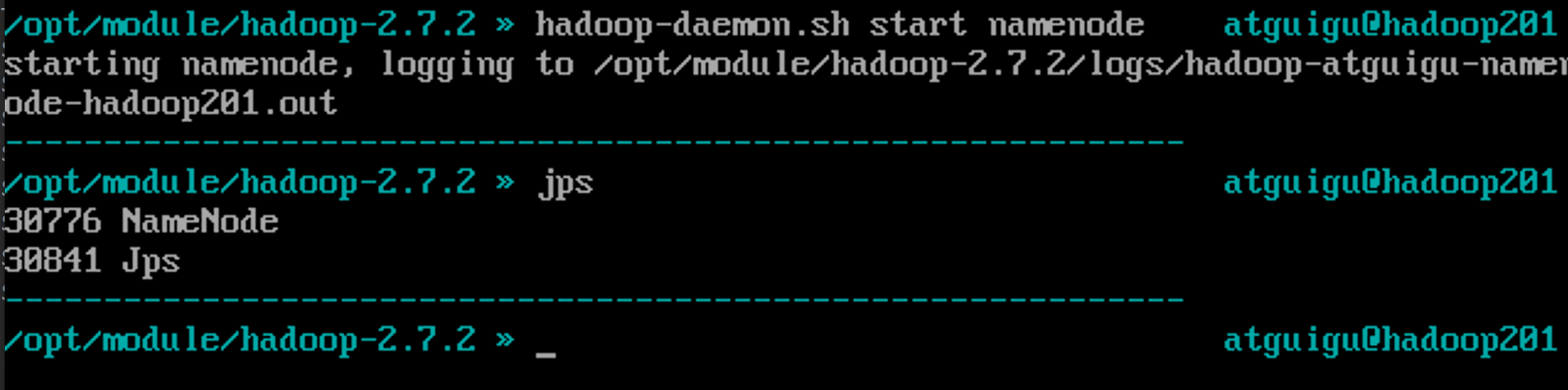

NameNodehadoop namenode -format在

hadoop201上启动NameNodehadoop-daemon.sh start datanode

分别在

hadoop201, hadoop202, hadoop203上分别启动DateNodehadoop-daemon.sh start datanode在

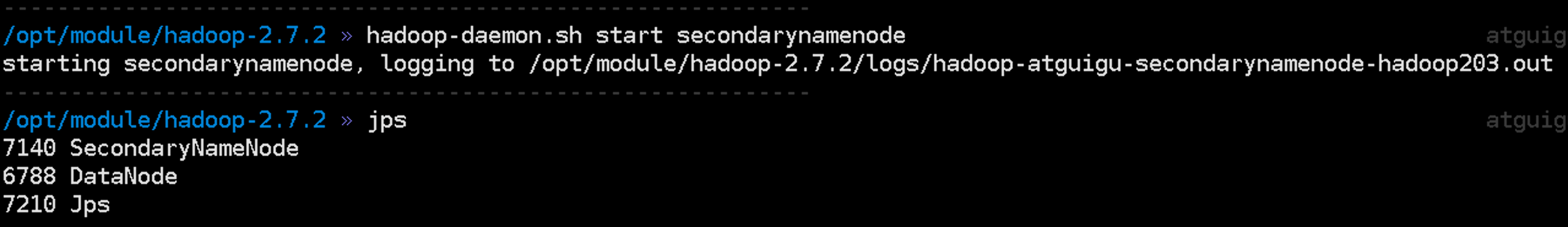

hadoop203上启动secondarynamenodehadoop-daemon.sh start secondarynamenode

在

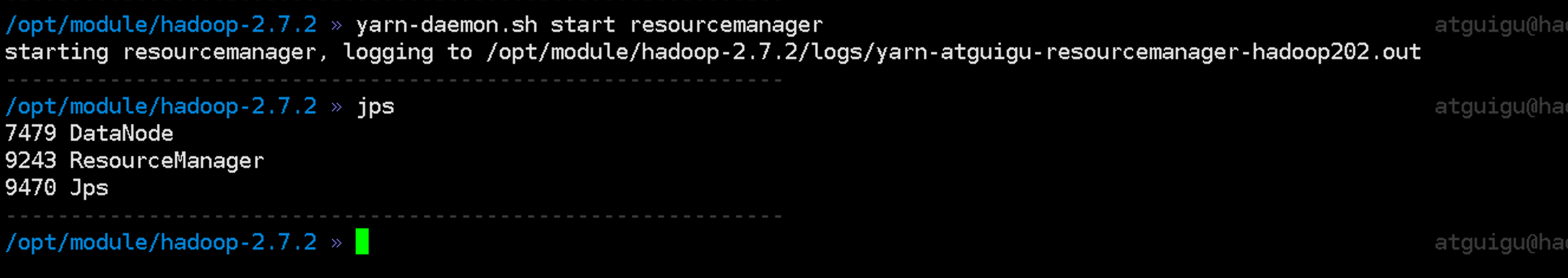

hadoop202上启动resourcemanageryarn-daemon.sh start resourcemanager

分别在

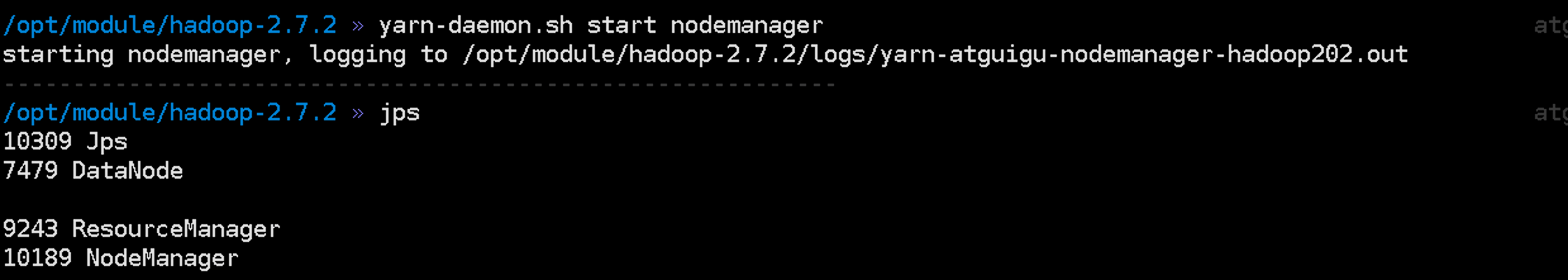

hadoop201, hadoop202, hadoop203上启动nodemanageryarn-daemon.sh start nodemanager

集群统一启动

上面单点启动方式最大的弊端就是需要到每个服务器节点上单独去启动, 非常的不方便.

如果能够在某一个服务器节点上启动, 则其他服务器节点上也能随着启动就好了.

如果想做到集群统一启动,我们需要先做 2 个配置:

SSH无密登录etc/hadoop/slaves文件配置上所有的服务器节点

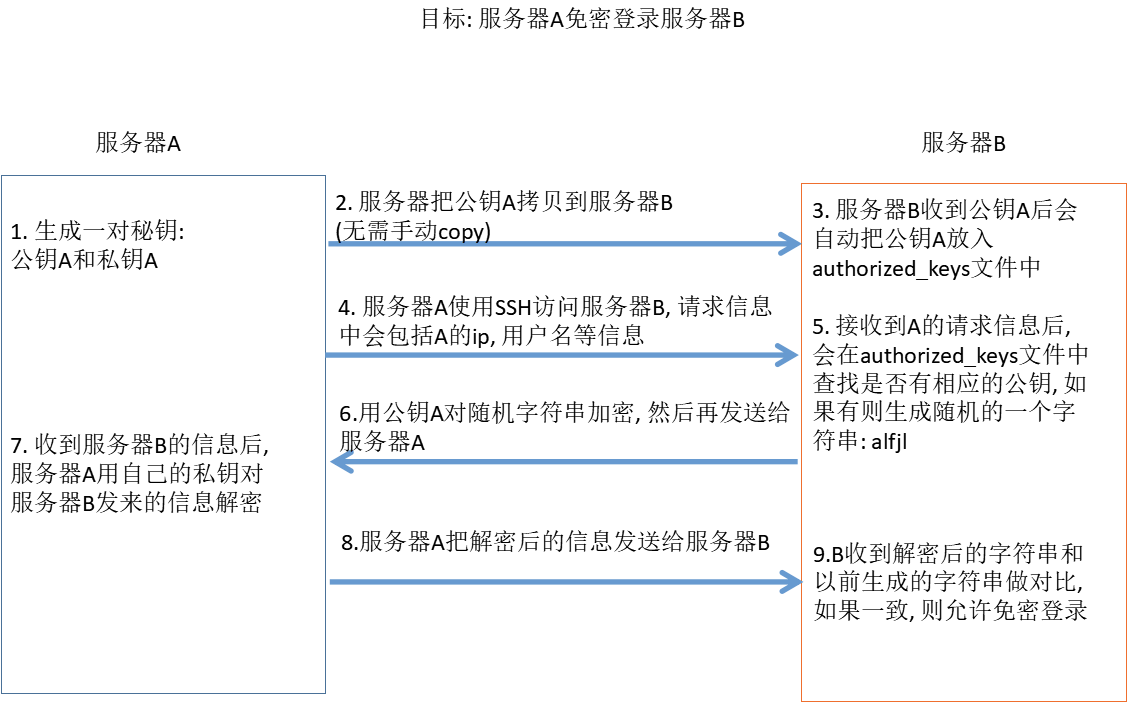

SSH无密登录

原理

生成秘钥和copy秘钥

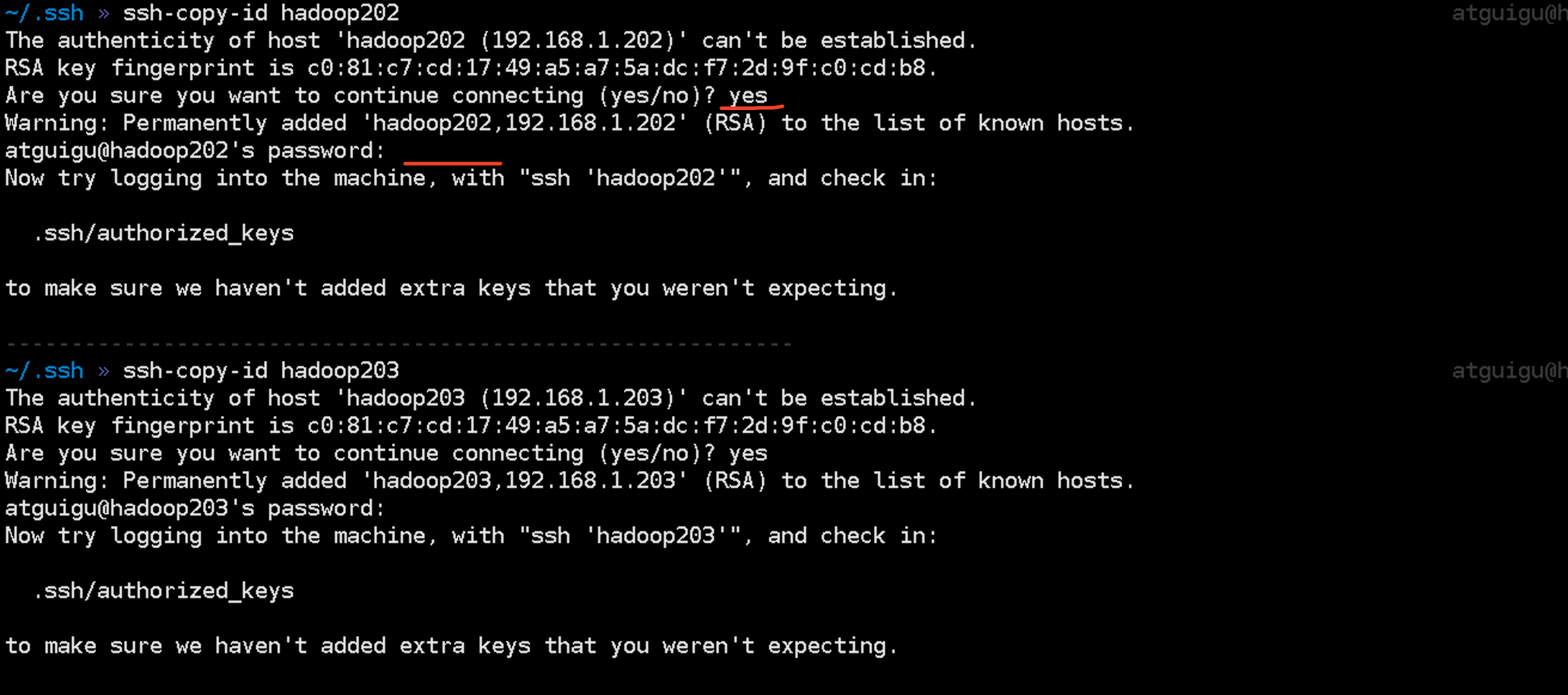

hadoop201可以免密登录到hadoop202, hadoop203

生成秘钥:

输入命令

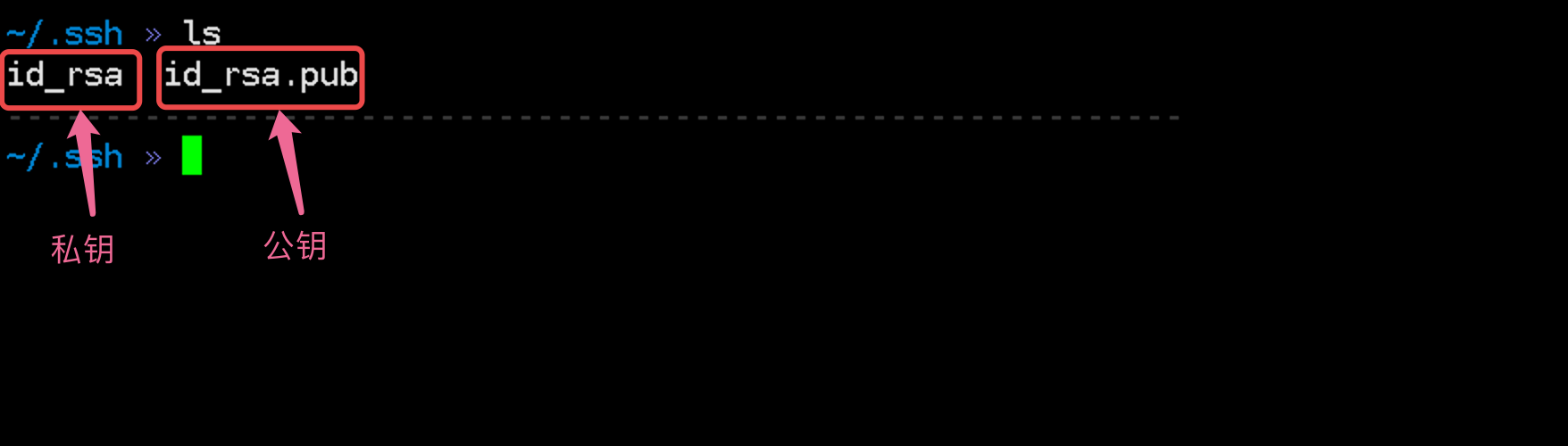

ssh-keygen, 然后连敲 3 次回车. 过程不要输入任何信息.

生成秘钥都存储在:

~/.ssh目录下:

copy公钥到其他设备ssh-copy-id 主机

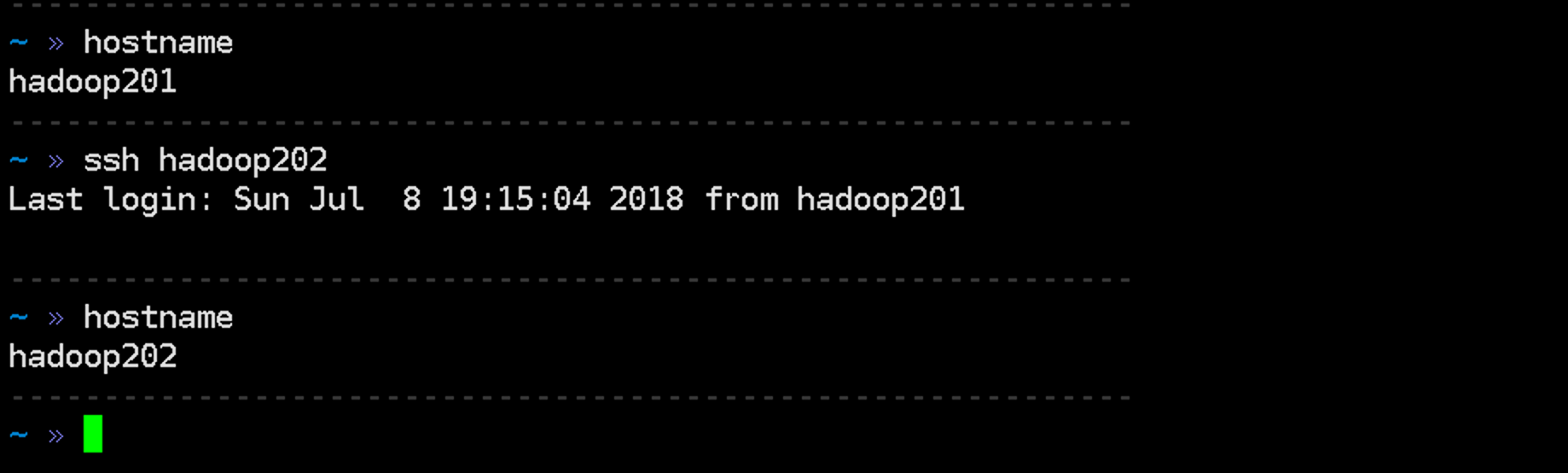

测试能否免密登录:

ssh hadoop202

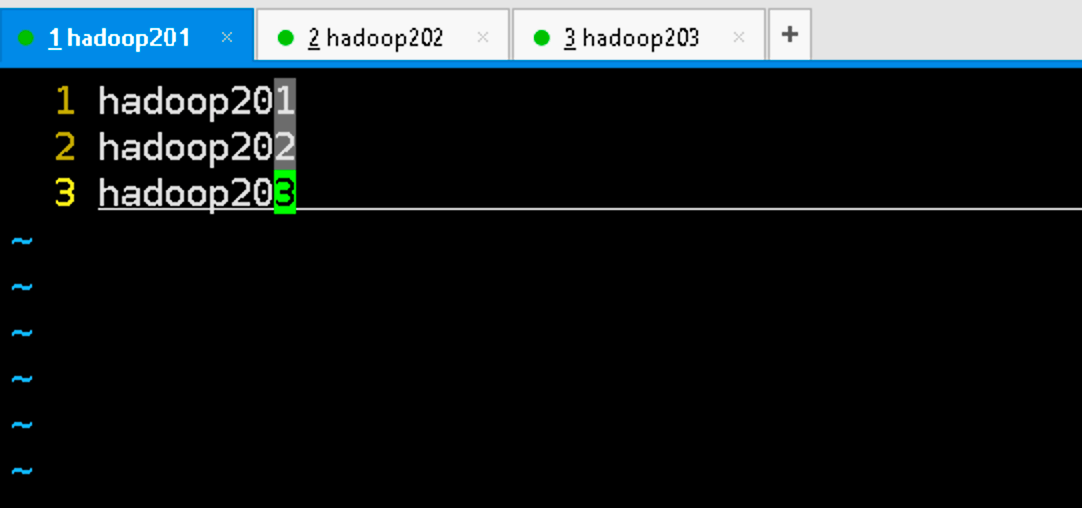

配置etc/hadoop/slaves

vim etc/hadoop/slaves

分发到其他节点:

my_rsync hadoop-2.7.2

启动集群

有一点需要注意: 启动resourcemanager, 必须去配置他的服务器上启动. 否则启动会失败.

所以, 对我们当前的配置来说, 最好去hadoop202上启动所有的服务.

先在hadoop202生成秘钥, 然后分发给hadoop201, hadoop202, hadoop203. 为了方便ssh, 我们也给hadoop202自己登录自己添加上免密登录.

统一启动

namenode, secondarynamenode,datanodestart-dfs.sh这个命令可以做以下事情:

- 在配置的主机上启动

namenode - 在配置的主机上启动

secondarynamenode - 在每个

slave主机上启动datanode

- 在配置的主机上启动

统一启动

resourcemanager, datamanagerstart-yarn.sh这个命令可以做如下事情:

- 如果当前主机配置了

resourcemanager, 则在当前主机启动resourcemanager. 否则就不启动resourcemanager - 在每个

slave主机上启动nodemanager

- 如果当前主机配置了

集群统一停止

stop-yarn.sh停止resourcemanger和nodemanagerstop-dfs.sh停止namendoe, secondarynamnode, datanode